Metaは5月11日、韓国を含むアジア太平洋(APAC)地域で、Instagramの「青少年アカウント」に対する保護機能の強化を順次進めると発表した。14~18歳のユーザーを対象に、有害表現や危険行為に関するコンテンツの表示を広く制限し、不適切なアカウントとの接触も制限する。

今回のアップデートは、青少年に表示されるコンテンツの安全基準を見直すもの。Metaは2025年10月に米国や英国などで先行導入しており、今回、Metaは対象地域をAPACへ広げる。

新たな基準では、14~18歳の青少年ユーザーに対し、暴力的表現や危険行為、有害行為を助長するおそれのあるコンテンツの表示を幅広く制限する。基準は米映画協会(MPA)のガイドラインを参考に設計しており、フィード、ストーリーズ、コメント、ダイレクトメッセージ(DM)、検索など、サービス全体で一貫して適用する。

また、年齢にそぐわない投稿を繰り返すアカウントとの接触も制限する。青少年ユーザーはこうしたアカウントをフォローできず、すでにフォローしている場合でも、コンテンツの閲覧や相互のやり取りができなくなる。

制限は双方向に及ぶ。成人向けコンテンツを投稿する側も、青少年にDMを送ったり、投稿にコメントしたりすることはできない。

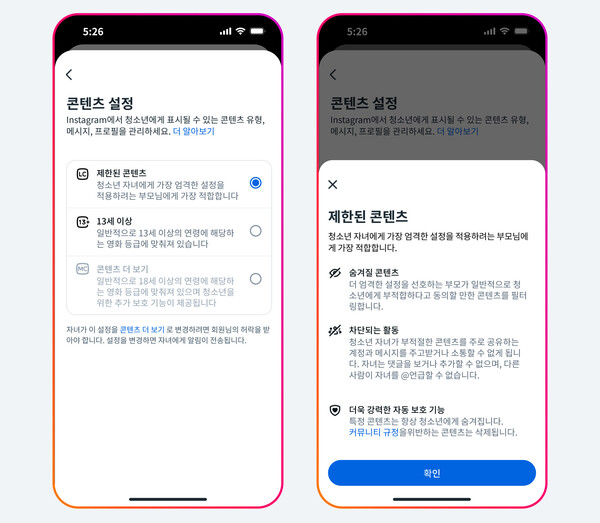

Metaは年内に、保護者向けの「制限付きコンテンツ」設定も導入する。保護者は子どもに表示されるコンテンツの基準をより厳格に設定でき、コメント機能も含めて細かく管理できるようになる。強化した青少年アカウントの設定は、今後FacebookとMessengerにも順次適用する予定だ。

Metaの関係者は「青少年がオンラインでも安全で年齢に応じたコンテンツに触れられるよう、青少年アカウントの保護機能を強化している」とコメントした。そのうえで、「今後も保護者と青少年の双方が安心してプラットフォームを利用できるよう、安全ポリシーと保護機能の改善を続ける」と述べた。