Gartnerは、AIの推論単価が今後大幅に下がっても、企業の実質的なAI負担は必ずしも軽くならないとの見方を示した。AIエージェントの利用拡大でトークン消費が膨らみ、単価低下の効果を打ち消す可能性があるためだ。

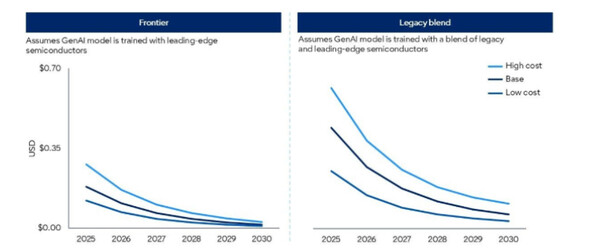

同社が30日に公表したレポートによると、1兆パラメータ級の大規模言語モデル(LLM)の推論コストは、2030年までに2025年比で90%以上低下する見通しだ。2022年初頭の同規模モデルと比べると、最大100倍の効率改善が見込まれるという。

コスト低下の要因としては、半導体やインフラの効率向上、モデル設計の革新、推論特化型半導体の普及、エッジデバイスへの適用拡大を挙げた。

ただ、Gartnerは、トークン単価の下落がそのまま企業のAIコスト削減にはつながらないと分析する。AIエージェントは従来型チャットボットに比べ、1タスク当たりのトークン消費量が5〜30倍に増えるためだ。単価低下を上回るペースで利用量が増える可能性があるとしている。

コスト最適化策としては、マルチモデル・オーケストレーションを提案した。反復的で頻度の高い業務は小型モデルやドメイン特化型言語モデルで処理し、フロンティアモデルの推論は高付加価値の複雑な業務に限定して使うべきだとした。

Gartnerのシニアディレクターアナリスト、ウィル・ソマー氏は「基本的なAI機能は実質的にゼロコストに近づいているが、高度な推論を支えるコンピューティング資源とシステムは依然として限られている」と述べた。

著者について