中国のAI企業Z.aiは、軽量AIモデル「GLM-4.7-Flash」を公開した。主要ベンチマークでOpenAIの「GPT-OSS-20B」を上回る性能を示したとしており、MITライセンスで提供する。モデルはHugging Faceから入手できる。

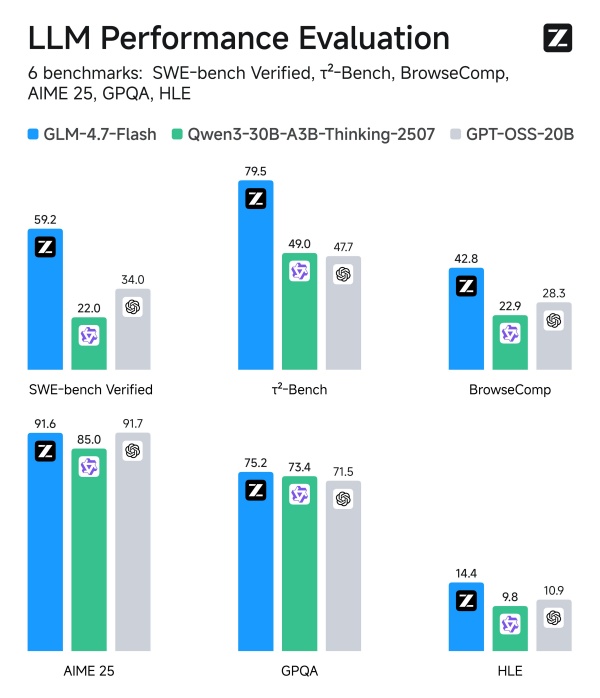

20日付のGigazine報道によると、GLM-4.7-Flashは推論性能など複数の主要指標でGPT-OSS-20Bを明確に上回った。

GLM-4.7-Flashは、複数の専門モデルを組み合わせるMoE(Mixture of Experts)アーキテクチャを採用する。総パラメータ数は300億、アクティブパラメータは30億で、計算負荷を抑えながら性能を確保した点を特徴とする。

比較対象には、Qwen3-30B-A3B-Thinking-2507(総300億パラメータ、アクティブ30億)やGPT-OSS-20B(総210億パラメータ、アクティブ36億)が含まれる。Web検索能力を測るBrowseCompでも、競合モデルを大きく上回ったとしている。

同モデルはオープンモデルとしてMITライセンスで公開している。モデルデータはHugging Faceからダウンロードできる。BF16版の動作には45GB超のVRAMが必要で、Z.aiはRTX 4090で動作可能な量子化版も近く提供する予定だ。

業界では、MITライセンスを採用した点にも注目が集まっている。商用利用が可能な高性能軽量モデルの登場は、OpenAIをはじめとするビッグテック主導の市場構図に影響を及ぼす可能性がある。

アクセス性の改善にも期待がかかる。現時点のBF16版はエンタープライズ向けGPUを必要とするが、量子化版が投入されれば状況は変わりそうだ。RTX 4090のような一般向けGPUで動作可能になれば、個人開発者や中小企業の参入障壁を下げ、オープンソースのエコシステム拡大を後押しする可能性がある。

今回の動きは、AI開発競争が単純な規模の拡大から、効率性を重視する方向へ移りつつあることを示している。小型化と高性能化を両立する軽量モデルが増えれば、高性能AIをローカル環境で活用する動きは一段と広がりそうだ。

Z.aiはSNSへの投稿で、GLM-4.7-Flashについて「ローカル環境でのコーディングやエージェント用途に適したアシスタントであり、30B級の新たな基準になる」と紹介している。