NVIDIAは1月6日、CES 2026で次世代AIプラットフォーム「Rubin」を発表した。先進的なAIスーパーコンピューター向けに設計した6種類の新チップで構成し、学習時間の短縮と推論時のトークン当たりコストの削減を狙う。Rubin搭載製品は2026年下半期にパートナー企業を通じて提供する予定だ。

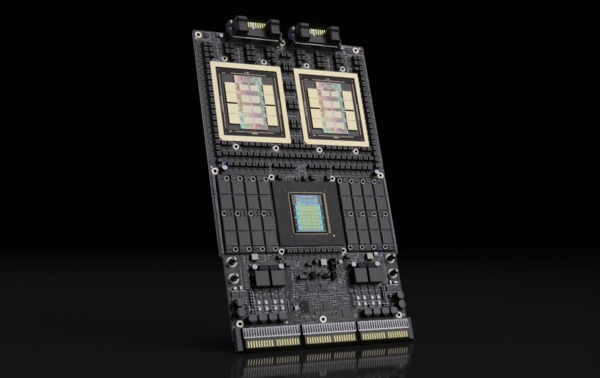

Rubinプラットフォームを構成するのは、Vera CPU、Rubin GPU、NVLink 6 Switch、ConnectX-9 SuperNIC、BlueField-4 DPU、Spectrum-6 Ethernet Switchの6種類のチップ。NVIDIAは、プラットフォーム全体にわたって緊密な協調設計を施したとしている。

その結果、推論時のトークン当たりコストはBlackwellプラットフォーム比で10分の1に抑え、MoEモデルの学習に必要なGPU数も従来比で4分の1に削減できるという。

同社は、こうした改善が最新のNVLinkインターコネクト技術、Transformer Engine、Confidential Computing、RAS Engine、Vera CPUの採用によるものだと説明した。

Rubinはすでに量産段階に入っている。Rubinベース製品は2026年下半期に投入する計画で、2026年中にVera Rubinベースのインスタンスをいち早く展開するクラウド事業者として、AWS、Google Cloud、Microsoft、OCIを挙げた。クラウドパートナーとしてはCoreWeave、Lambda、Nebius、Nscaleなどが名を連ねる。

Microsoftは今後、Fairwater AIスーパーファクトリーを含む次世代AIデータセンターに、Vera Rubin NVL72のラックスケールシステムを展開する計画だ。

第6世代NVLinkは、GPU当たり3.6TB/sの帯域幅を実現する。Vera Rubin NVL72ラックでは、全インターネットを上回る260TB/sの帯域幅を提供するという。Vera CPUは、カスタムのOlympusコア88基を搭載し、Armv9.2互換と高速なNVLink-C2C接続に対応する。

Rubin GPUには、ハードウェアアクセラレーションによる適応型圧縮技術に対応した第3世代Transformer Engineを搭載した。AI推論向けには50ペタフロップスのNVFP4演算性能を提供する。

BlueField-4には、高度なセキュリティ信頼資産アーキテクチャ「ASTRA」を採用した。AIインフラ事業者が性能低下を伴わずに大規模AI環境を安全にプロビジョニング、分離、運用できるようにするもので、信頼の起点となる単一の制御ポイントを提供するシステムレベルの信頼アーキテクチャとしている。

Spectrum-X Ethernetのフォトニクス共同パッケージング・オプティカルスイッチシステムは、AIアプリケーション向けに信頼性を10倍、稼働時間を5倍に高めるとしている。

NVIDIAの創業者兼CEO、ジェンスン・ファン氏は「AIの学習と推論に対する計算需要がかつてない水準で拡大するなか、Rubinは絶好のタイミングで投入される」と述べた。そのうえで「NVIDIAは毎年、次世代AIスーパーコンピューターを示してきた。6つのチップを緊密に協調設計したRubinは、AIの新たな地平を切り開く」とコメントした。