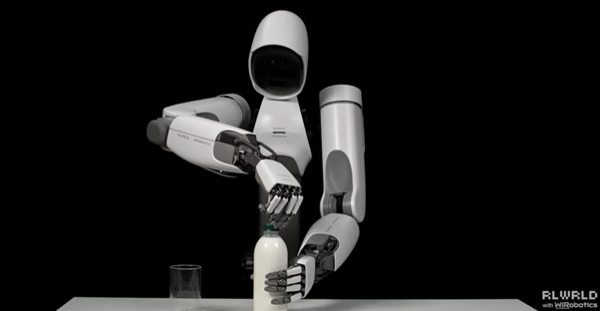

フィジカルAIを手掛けるRLWRLDは1月6日、NVIDIA Researchが公開したヒューマノイドロボット向けAIモデル「NVIDIA Isaac GR00T N1.5」を活用し、自社ロボット「Allex」に搭載した5指ハンドの物体操作学習を強化していると発表した。

物体をつかんで運ぶ動作は一見単純に見えるが、実際にはカメラで周囲を認識し、状況を理解したうえで、指先を精密に制御しながら一連の動作を途切れなく実行する必要があるという。

とりわけ5指ロボットハンドは関節数が多く、動きも複雑になりやすい。わずかな誤差でも失敗に直結するため、RLWRLDは事前学習済みの公開モデルであるGR00T N1.5を自社ロボット向けに最適化し、追加学習(ファインチューニング)によって精密な把持・操作性能の向上を図っている。

同社は、1回の学習で目標性能に到達するのは難しいと説明する。実験と改善を素早く繰り返せる環境を整えることが、性能向上の鍵になるとしている。

RLWRLDのBae Jaekyung CTOは「GR00T N1.5をベースに自社ロボット向けの追加学習を進めたことで、ファインチューニングの速度が上がり、反復実験のサイクルを大幅に短縮できた」とコメントした。さらに「反復学習で不足していたデータを補いながら学習を最適化することで、ロボットハンドは実運用に耐え得る水準へと近づく」と述べた。

RLWRLDは年初に、独自のVLA(Vision-Language-Action)モデルを公開する計画も明らかにしている。大規模モデルとして設計し、言語理解と視覚認識の性能を高めることで、ロボットハンドの操作精度と動作の自由度をさらに向上させる考えだ。