AI軽量化技術を手掛けるNotaは2026年2月20日、Upstageの大規模言語モデル(LLM)「Sola 100B」のメモリ使用量を72.8%削減する量子化技術を開発したと発表した。MoE(Mixture of Experts)に特化した手法を適用し、性能指標であるPPL(Perplexity)も元モデルに近い水準を維持したとしている。

この技術は、科学技術情報通信部が主導する「独自AIファウンデーションモデル」プロジェクトの一環として開発した。

Notaが独自開発したのは、MoEアーキテクチャ向けの「Nota MoE量子化」手法。従来の量子化ではモデル全体を一括で圧縮するため性能低下が避けにくかったのに対し、同手法は専門家モデルごとの特性を分析し、重要部分の精度を維持しながら重要度の低い領域を選別して圧縮するのが特徴だ。

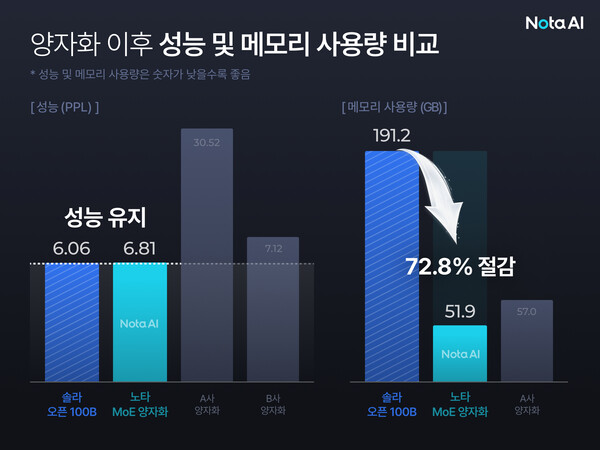

Notaによると、同技術を適用したSola 100Bのメモリ使用量は191.2GBから51.9GBに減少した。PPLは6.81で、元モデルの6.06に近い水準を維持したという。一部の汎用量子化手法では性能低下が大きかったケースと対照的だとしている。Notaは同技術について特許を出願した。

今回の成果により、ロボットや自動車などのオンデバイスAI環境でも、100B級モデルを搭載できる可能性が高まるとしている。高性能GPUの確保が難しい企業にとっては、運用コストの削減にもつながるとNotaは説明した。

Notaのチェ・ミョンス代表は「デバイス上で大規模モデルを実装する需要が拡大するほど、Notaの軽量化・最適化技術が中核的な役割を担うことになる」とコメントした。