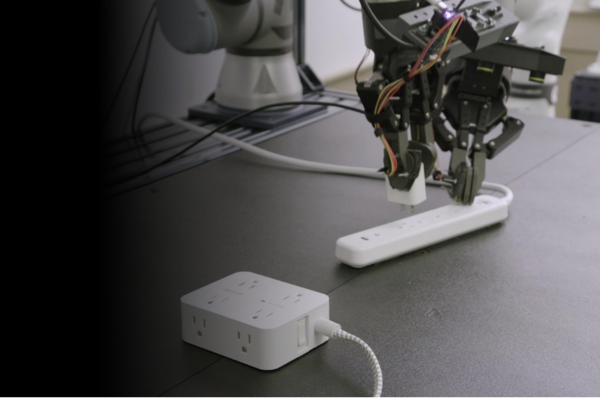

Microsoftは1月23日、Phiシリーズの視覚・言語モデルを基盤とするフィジカルAI向けロボティクスモデル「Rho-alpha」を発表した。自然言語の指示を双腕操作の制御信号に変換し、より柔軟に環境へ適応できるロボットシステムの実現を目指す。

同社によると、これまでロボットは、作業内容が予測可能で厳密に定義された組み立てラインなど、構造化された環境で活用が進んできた。一方、物理システム向けの視覚・言語・行動(Vision-Language-Action、VLA)モデルの登場により、複雑で変化の大きい非構造環境でも、人と協調しながら認識・推論・行動できる可能性が広がっているという。

Rho-alphaは、自然言語の指示に基づいてロボットの双腕操作を制御信号に変換するモデルだ。Microsoftは、従来のVLAで一般的だった認知・学習モダリティの枠を広げた点を特徴として挙げている。

Microsoft Research Acceleratorのバイスプレジデントを務めるアシュリー・ローレンス氏は、「認知面では新たに触覚センシングを組み込み、現在は力など追加のセンシングモダリティの拡張を進めている」と説明した。さらに「学習面では、実環境への導入後も人のフィードバックを取り込み、性能を継続的に改善できるよう設計した」と述べた。

Microsoftはあわせて、自社のロボットシステムへの導入やユースケース開拓を進めるパートナー向けに、「Rho-alpha Research Early Access Program」を開始する。

ワシントン大学のアビセク・グプタ教授は、「ロボットを遠隔操作して学習データを生成する手法は業界標準となったが、遠隔操作が現実的でない、あるいは不可能な環境は依然として多い」と指摘した。Microsoft Researchと協力し、シミュレーションと強化学習を組み合わせて多様な合成デモデータを生成し、実機ロボットから収集した事前学習データセットを拡充しているという。