搜索关键词 MoE

AI & Enterprise

DeepSeek发布V4系列模型:开源低价,对标Opus 4.7和GPT-5.5

中国AI公司DeepSeek推出V4系列模型,主打开源和低价。其中,V4 Pro采用1.6万亿参数MoE架构,支持100万token上下文;V4 Pro和V4 Flash均基于约33万亿token完成训练,多项基准测试表现接近Opus 4.7和GPT-5.5。市场分析认为,其性价比优势或推动企业采用,但地缘政治和使用依赖风险仍需关注。

AI & Enterprise

Nota AI获NVIDIA Nemotron黑客松综合第一

Nota AI宣布,公司在NVIDIA Nemotron黑客松中凭借用于混合专家(MoE)量化的合成数据生成技术,从20支参赛队伍中获得综合第一。本次赛事围绕AI Agent、领域模型优化和合成数据管线设计三大方向展开。

AI & Enterprise

SK Telecom深化与NVIDIA合作,A.X K2研发提速

SK Telecom在“NVIDIA Nemotron Developer Days Seoul 2026”上介绍了与NVIDIA在AI大模型开发方面的合作进展,并披露A.X K1后续模型A.X K2的研发计划。双方自基于A100 GPU的超级计算机“Titan”公布以来,便围绕数据、基础设施和训练环境展开协作,合作范围已进一步延伸至多模态和视觉语言模型(VLM)等领域。

-

Industry

NVIDIA:AI芯片竞争转向端到端效率,Blackwell在MoE推理中较上一代Hopper快55倍

-

AI & Enterprise

Moonshot AI发布开源大模型Kimi-K2.6,称多项基准测试成绩超越GPT-5.4和Claude Opus 4.6

-

AI & Enterprise

Google DeepMind发布Gemma 4,性能升级并转向Apache 2.0开源许可

-

AI & Enterprise

H Company发布AI代理Holo3:支持读屏并执行跨应用任务

-

AI & Enterprise

Google发布Gemma 4开放权重模型,可在低功耗设备端本地运行复杂推理

-

AI & Enterprise

韩国医学、生物领域AI基础模型通过中期评估 转入第二阶段开发

-

AI & Enterprise

iPhone本地运行近400B参数大模型迎来新进展

-

Industry

NVIDIA在GTC 2026发布Vera Rubin并公布Groq 3 LPX,AI加速迈向制造、出行与医疗场景

-

AI & Enterprise

NVIDIA推出Nemotron Super 3,面向大规模Agentic AI应用,吞吐提升5倍

-

AI & Enterprise

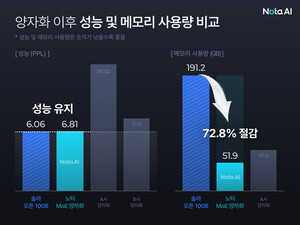

Nota将Upstage“Solar 100B”内存占用压缩至51.9GB,降幅达72.8%

-

Games & Commerce

Kakao将AI组织整合至“AI Studio”体系,Jeong Sina兼任负责人

-

AI & Enterprise

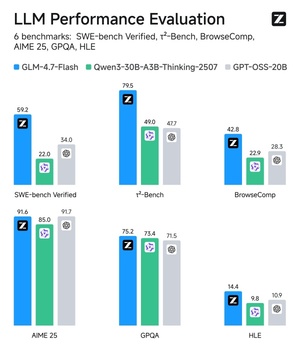

Z.ai发布轻量级模型GLM-4.7-Flash,多项基准测试领先GPT-OSS-20B

-

AI & Enterprise

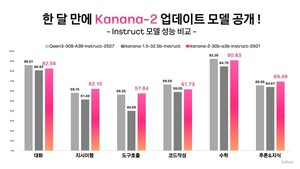

Kakao升级开源语言模型Kanana-2,新增4款模型强化Agent AI能力

-

AI & Enterprise

NC AI发布基础模型VAETKI:KV缓存内存占用降低约83%

-

AI & Enterprise

SK Telecom公开A.X K1技术报告:519B参数,数学与代码基准成绩出炉