AI轻量化企业Nota表示,已为Upstage大语言模型“Solar 100B”研发出量化技术,可将模型内存占用降低72.8%。

上述研发属于韩国科学技术信息通信部(MSIT)主导的“自主AI基础模型(Dokpamo)”项目的一部分。

Nota介绍,公司此次推出的是一套面向新一代大语言模型架构“专家混合”(MoE)的“Nota MoE量化”方案。与对整个模型进行统一压缩的传统量化方式不同,该方案会根据不同专家模块的特性进行分析,在需要保留精度的部分维持原有水准,同时对相对不重要的部分实施压缩,以尽可能减少性能损失。

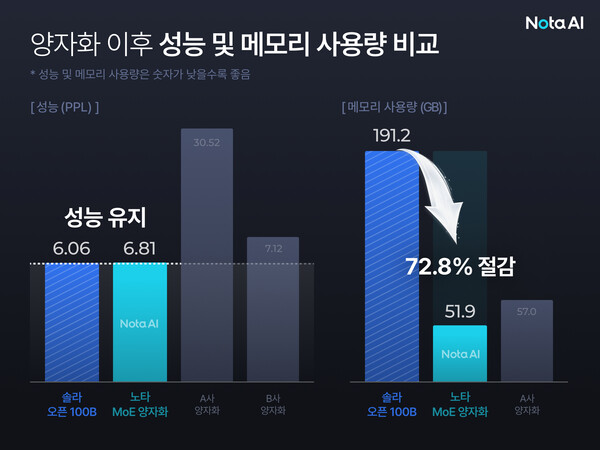

据Nota披露,在应用这项技术后,“Solar 100B”的内存占用由191.2GB降至51.9GB。性能指标PPL(Perplexity)为6.81,接近原模型的6.06。相比之下,部分通用量化方案可能导致性能劣化幅度超过5倍。Nota已就相关技术提交专利申请。

Nota认为,这一成果有望推动100B级模型在机器人、汽车等端侧AI场景落地,同时也可帮助难以获得高规格GPU的企业降低运营成本。

Nota CEO Chae Myeong-su表示,随着大模型端侧部署需求升温,Nota在模型轻量化和优化方面的技术能力将发挥更关键的作用。

记者信息