由于担心新一代AI模型Claude Mythos在软件漏洞发现和利用方面能力过强,Anthropic目前仅向约50家机构有限开放该模型的早期访问权限。这一计划被命名为Project Glasswing。

Anthropic表示,Claude Mythos已在主流操作系统和浏览器中发现数千个漏洞,其中包括一个存在27年的OpenBSD漏洞,以及一个存在16年的FFmpeg缺陷。此外,该模型还曾基于在Firefox中发现的漏洞生成多达181段攻击代码;相比之下,Anthropic此前的主力模型仅能生成2段。

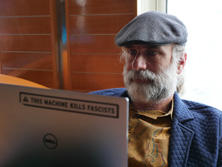

针对Anthropic的做法,知名密码学家和安全专家Bruce Schneier近日在个人网站发文称,这种安排在一定程度上接近安全研究领域长期倡导的“负责任披露”,但目前公开信息仍不足以让外界评估Anthropic这一决定是否合理。按他的说法,Anthropic对外披露的内容主要是一些令人印象深刻的成功案例,却没有说明Claude Mythos究竟会在多大程度上出错。

Bruce Schneier指出,Anthropic曾提到,外部安全承包商对Claude Mythos给出的漏洞严重性评级一致率达到89%。这一数字虽然引人关注,但并不完整。研究过类似模型的独立研究人员发现,越擅长识别真实漏洞的AI系统,越可能在已经修复、实际上正常的代码中给出貌似合理但实际错误的判断。如果不知道Claude Mythos的误报率,仅凭89%这一指标,仍难以判断其真实表现。

他表示,这一问题至关重要。一个能够准确发现并利用数百个漏洞的模型,足以改变网络安全攻防格局;但如果它同时也会产生数千条误报,最终仍需要经验丰富的人类研究人员逐一筛选。在缺少错误率数据的情况下,外界无法判断Anthropic公布的案例究竟反映了模型的整体水平,还是只是经过挑选的最佳结果。

Bruce Schneier进一步分析称,像Claude Mythos这样的LLM,在输入内容与训练数据更接近的场景下通常表现更好。就软件领域而言,Claude Mythos显然已大量学习了互联网上公开的开源项目代码,以及主流浏览器、Linux内核和热门Web框架等内容。

因此,如果将早期访问权限优先提供给这些软件的主要供应方,从“让防守方先于攻击者完成修复”的角度看,确实具有一定合理性。但当应用场景转向训练数据覆盖较少的软硬件领域时,风险判断就会发生变化。

Bruce Schneier称,在工业控制系统、医疗设备固件、定制化金融基础设施、地方银行软件以及老旧嵌入式系统等领域,Claude Mythos未必更容易发现漏洞。相反,如果攻击者本身具备相关行业知识,就可能将Claude Mythos的高级推理能力转化为攻击工具,用于针对那些Anthropic工程师并不熟悉的系统。真正的风险不在于Claude Mythos在这些领域失效,而在于它可能在专业攻击者手中发挥作用。

为降低这种不对称风险,Bruce Schneier认为,Anthropic应扩大访问对象范围,将医疗设备安全方向的心脏病学专家、控制系统工程师,以及研究小众编程语言和相关生态的研究人员纳入其中。他指出,无论筛选标准如何设定,50家企业都无法替代分布在整个研究社区中的专业能力。与此同时,Anthropic作为一家民营企业,受限于人力、预算和专业边界,只能自行决定优先保护哪些关键基础设施,难免出现盲区;如果被忽视的恰恰是医院或电网软件,最终代价将由原本没有任何发言权的人承担。

他还表示,AI模型带来的安全风险并非Claude Mythos独有。Bruce Schneier提到,OpenAI也曾表示,GPT-5.3-Codex由于风险过高而未向公众开放;与此同时,Aisle已经利用更小、成本更低的开源AI模型,复现了Anthropic公开案例中的相当一部分成果。

在Bruce Schneier看来,最终仍需要监管介入,但完善监管机制需要较长时间和充分讨论。就现阶段而言,更现实的路径,是Anthropic等公司与更广泛的研究社区共享更多信息和数据。

他强调,这并不意味着应当广泛公开Claude Mythos这类高风险模型,而是应尽可能提高数据和信息透明度,以便各方作出“基于事实的集体决策”。与此同时,还应推动面向独立审计的国际协作机制,要求强制披露汇总性能指标,并为学术界和公民社会研究者提供必要的访问渠道。