Krafton于2日发布AI模型品牌Raon,并在全球AI开发者平台Hugging Face开源四款基础模型,分别为语音语言模型、实时全双工语音模型、文本转语音(TTS)模型和视觉编码器。

Krafton表示,Raon这一名称取自意为“愉快”的韩语固有词。此次发布的基础模型,从数据采集、模型训练到性能评测,均由公司自主完成全流程研发。

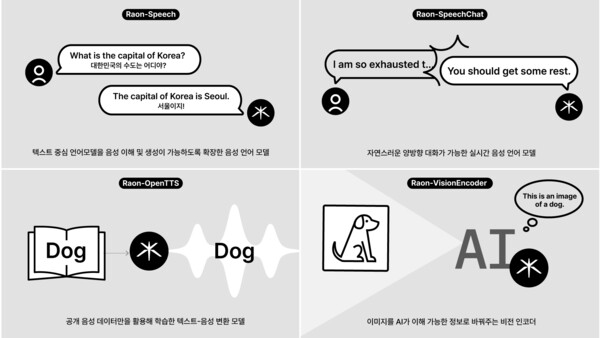

本次公开的模型包括Raon-Speech、Raon-SpeechChat、Raon-OpenTTS和Raon-VisionEncoder。

其中,Raon-Speech是一款基于文本大模型扩展而来的语音语言模型,支持语音理解与语音生成。该模型参数规模为90亿,在100亿参数以下的开源语音语言模型中,英语和韩语表现居首。Krafton称,这一结果基于对语音转文本、文本转语音、语音问答等7类任务、40项基准测试的综合评测。

Raon-SpeechChat则采用可在对话过程中实现插话的实时全双工对话技术。在3类全双工模型评测基准中,该模型在附和、插话处理、响应时延等13项任务上的平均成绩位居第一梯队。

Raon-OpenTTS是一款基于公开语音数据训练的文本转语音模型。Krafton表示,部分数据由公司自行采集并清洗后对外开放,完整训练数据后续也将以开源形式提供。

Raon-VisionEncoder用于将图像转换为AI可理解的信息。Krafton强调,该模型未依赖预训练模型,完全由团队自主训练完成;在部分视觉识别任务中,其成绩达到或超过Google视觉编码器SigLIP2的九成以上水平。相关技术计划用于“自研AI基础模型”项目。

Krafton首席AI官(CAIO)Kang Wook Lee表示,Raon系列模型此次开源,是公司AI技术积累的一部分。公司希望通过开放训练数据和核心模型,降低研究人员和开发者的使用门槛,并推动韩国AI生态发展。

此外,Krafton去年曾发布个人AI助手KIRA,并于上月开源了用于提升AI Agent性能的Terminus-KIRA技术。