Gartner表示,即使未来AI Token单价大幅下滑,企业的整体AI成本压力也未必会随之缓解。

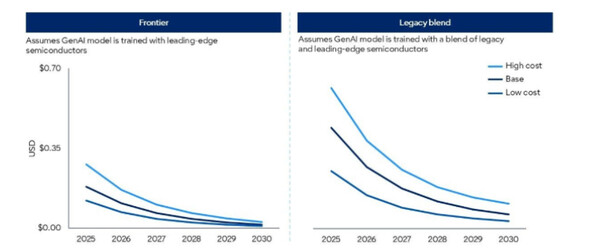

Gartner于3月30日发布报告称,到2030年,1万亿参数大语言模型的推理成本有望较2025年下降90%以上;若与2022年初期同等参数规模模型相比,成本效率最高可达其100倍。

Gartner认为,这一趋势主要受多重因素推动,包括半导体和基础设施效率提升、模型设计持续创新、推理专用芯片普及,以及边缘设备部署扩大等。

不过,该机构同时指出,Token单价下降并不意味着企业AI支出一定减少。与传统聊天机器人相比,AI Agent在单项任务中的Token消耗通常高出5倍至30倍。Gartner预计,使用量的增长速度可能快于单价下行速度,从而使企业AI总成本难以同步下降。

针对这一趋势,Gartner建议企业采用多模型编排策略,将重复性高、调用频繁的任务交由小模型或垂直领域专用语言模型处理,而将高端大模型的推理能力集中用于高附加值的复杂任务。

Gartner高级总监分析师Will Somer表示,基础AI能力正接近“几乎零成本”,但支撑高级推理的算力和系统资源仍然稀缺。

记者信息