SK hynix将参加当地时间3月16日至19日在美国加利福尼亚州圣何塞举行的“NVIDIA GTC 2026”,并在大会期间展示HBM4等AI内存产品。Chey Tae-won、Kwak Noh-jung等公司高管也将赴会,与全球科技企业就AI技术演进、基础设施架构变化以及中长期合作方案展开交流。

SK hynix于3月17日表示,NVIDIA GTC是面向全球企业和开发者的AI与加速计算大会,主要用于展示最新技术成果并分享产业发展方向。公司计划借此次大会,进一步展现其在AI内存领域的技术实力。

本届大会上,SK hynix将以“Spotlight on AI Memory”为主题设立展区,集中展示AI内存产品线。公司表示,其相关产品已应用于NVIDIA AI基础设施,可在AI训练和推理过程中缓解数据传输瓶颈、提升系统性能。此次展出也将体现双方合作成果,以及内存在AI时代基础设施中的关键作用。

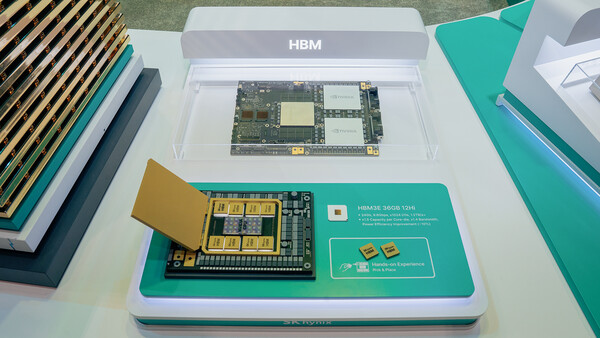

展区将分为NVIDIA合作区、产品区和互动体验区三部分。其中,在入口处的NVIDIA合作区,SK hynix将通过模型和实物展示HBM4、HBM3E、SOCAMM2等产品在NVIDIA AI平台上的应用案例,同时展出与NVIDIA联合开发的液冷eSSD,以及搭载LPDDR5X的NVIDIA AI超级计算机“DGX Spark”。

产品区将介绍HBM4、HBM3E、大容量服务器DRAM模组、LPDDR6、GDDR7、eSSD及车载内存解决方案等AI内存产品。参观者可通过摇杆选择感兴趣的产品,查看其主要特点和应用案例。

互动体验区则设置了以HBM堆叠结构为灵感的“HBM 16层堆叠游戏”。参观者可通过虚拟堆叠内存芯片的方式,直观了解TSV工艺及高层堆叠封装技术。

除展览外,SK hynix还将参加大会技术分论坛。负责DT业务的副社长Do Seung-yong将于17日在“Building the Future of Manufacturing”分论坛发表联合演讲,介绍AI技术在工艺创新中的应用案例,并分享AI基础设施方案。AI Platform SW团队负责人Moon Dong-wook将于19日在“How HBM4 Unlocks Efficient LLM Serving at Scale”分论坛上,围绕LLM推理中的内存带宽和容量瓶颈,介绍基于HBM4的应对思路。

SK hynix相关人士表示,随着AI技术持续发展,内存已不再只是单一零部件,而是影响AI基础设施整体架构与性能的关键因素。公司将依托覆盖数据中心到终端侧的内存技术能力,继续与全球合作伙伴共同推动AI产业发展。