SanDisk宣布将核心算法SP Random(SanDisk Pseudo Random,伪随机)开源,称可将原本需要约一周的企业级SSD预处理时间压缩至6.5小时左右,从而提升数据中心存储部署效率。

据TechRadar当地时间12日报道,SanDisk近日已将SP Random作为存储测试工具FIO(Flexible IO Tester)的扩展插件发布,供行业采用。

企业级SSD在正式投入生产环境前,通常需要先进行预处理,以确保性能趋于稳定。在这一过程中,控制器会持续写入数据,并执行垃圾回收、磨损均衡等内部管理操作。只有进入稳态(steady-state)后,SSD的I/O性能才能在实际生产环境中保持一致且可预测。

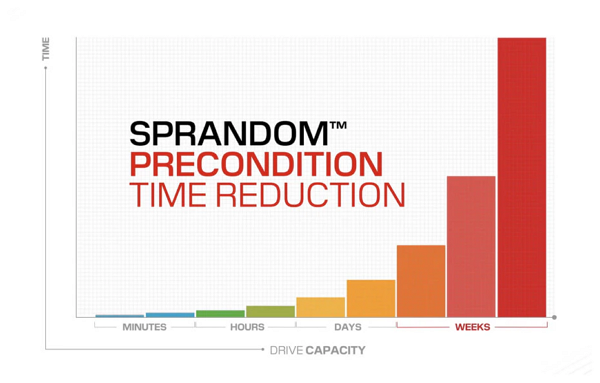

按照传统方法,预处理通常需要写入相当于SSD总容量两倍以上的数据。以128TB SSD为例,完成预处理约需160小时;采用SP Random后,可缩短至6.5小时。对于256TB大容量SSD,预处理时间也可由约250小时压缩至同样的6.5小时,节时最高超过97%。

SanDisk表示,这一效率提升主要来自SP Random对预留空间分布方式的预先计算。与反复写入数据的传统做法不同,该算法通过一次物理写入即可完成预处理。具体而言,SP Random会对SSD空间进行重叠划分,并根据地址调整分布,以数学方法降低实现性能稳定所需的资源消耗。

随着该技术以开源方式推出,存储行业采用相关方案的门槛也将随之降低。报道指出,这对需要快速上线大规模SSD的超大规模数据中心和AI基础设施运营方尤其具有现实意义。若单盘准备周期可缩短150小时以上,云服务商的部署速度和运营效率都有望得到提升。

尤其是在数千块SSD并行运行的AI工作负载场景下,系统对细微的性能波动也十分敏感。在强调一致性的AI训练和推理环境中,SP Random有望成为提升基础设施效率的一项关键技术。相比之下,普通消费级PC通常以单盘为主,预处理时间缩短带来的实际感知可能并不明显。

报道认为,SanDisk此举为需要管理大规模存储阵列的企业提供了一种具备落地性的工程方案。随着其通过数学方法验证了实际节时效果,这项技术未来或将对AI基础设施建设节奏及全球数据中心运维效率产生更广泛影响。