在尽量保留 Claude Code 使用体验和工作流的基础上,开源项目 deepclaude 试图通过替换底层模型来压缩使用成本。对开发者而言,无需改变原有界面或 CLI 工作流,只需将模型后端切换至 DeepSeek V4 Pro、OpenRouter 等服务,即可降低调用费用。

据海外媒体 Gigazine 5 月 11 日报道,deepclaude 在保留 Claude Code CLI 与自主代理循环能力的同时,将原本依赖 Anthropic 的模型调用转接至其他后端。其 GitHub 仓库也将“Same UX, 17x cheaper”作为主要卖点,强调在体验基本不变的前提下,成本可低至原来的约 1/17。

Claude Code 是一款 AI 编码代理,支持读取和编辑文件、执行 Bash 命令、进行 Git 操作,并可在多步骤任务中持续推进执行流程。开发者只需用自然语言下达指令,工具便可修改代码、执行命令并持续完成后续步骤。不过,若要高频使用,通常需要订阅 Anthropic 月费约 200 美元的套餐,成本一直是外界关注的主要问题之一。

deepclaude 的核心思路,是在现有框架下仅替换模型调用链路,而不大幅改动 Claude Code 原有交互方式。该项目可接入 DeepSeek V4 Pro、OpenRouter、Fireworks AI 以及兼容 Anthropic API 的其他后端,使开发者在基本不改变使用习惯的情况下,转向价格更低的模型服务。

从功能来看,deepclaude 并不只是简单替换对话模型。它支持文件读取、写入与编辑,执行 Bash 和 PowerShell 命令,进行 Glob 与 Grep 搜索,并覆盖多阶段自主代理循环、子代理执行、Git 操作和项目初始化等开发环节,整体上延续了 Claude Code 的核心工作流,重点在于让代理能力运行在成本更低的模型之上。

不过,deepclaude 也并非原生 Claude Code 的完全替代方案。在兼容性方面,DeepSeek 的 Anthropic 兼容端点暂不支持图像输入,MCP 服务器工具也无法在这一兼容层中运行。提示缓存方面,deepclaude 采用的是 DeepSeek 的自动缓存机制,而非 Anthropic 的“cache_control”方式,因此虽然整体兼容范围较广,但与原生环境仍存在差异。

性能表现则会随任务类型而变化。根据 deepclaude 的介绍,在日常开发中约 80% 的任务里,DeepSeek V4 Pro 的表现接近 Claude Opus;但在涉及复杂推理的部分任务中,Claude Opus 仍被认为更具优势。也就是说,更实际的使用方式,是将常规任务交给 DeepSeek 系列模型处理,遇到更复杂的问题时再切回 Anthropic 模型。

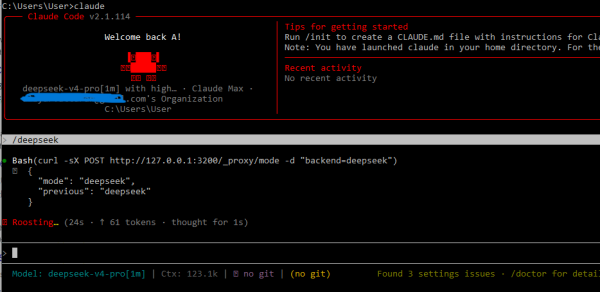

此外,deepclaude 还支持在会话过程中实时切换后端。其本地代理服务器运行在 localhost:3200,可将 Claude Code 的模型请求转发至当前选定的后端,从而实现无需重启即可在 DeepSeek、OpenRouter、Anthropic 等服务之间切换。

从价格来看,DeepSeek V4 Pro 的输入和输出价格分别约为每 100 万 token 0.44 美元和 0.87 美元;相比之下,Anthropic 旗下 Claude Opus 4.7 的输入和输出价格分别为每 100 万 token 5 美元和 25 美元。报道指出,DeepSeek 当前报价为折扣期价格,但即便折扣结束,整体仍有望维持相对低成本结构。

从行业观察来看,deepclaude 也反映出 AI 编码代理市场的一种新趋势。过去,开发工具往往深度绑定特定 AI 服务;未来,同一工作环境下按需切换模型的模式或将更常见。随着开发者对成本和性能进行任务级灵活调配的需求上升,deepclaude 正被视为这一变化的代表性案例之一。